Trusted Flagger sind Meldestellen für illegale Online-Inhalte. Sie sehen sich seit ihrer gesetzlichen Verankerung Kritik von rechts ausgesetzt. „Zensur“ lautet der Vorwurf.

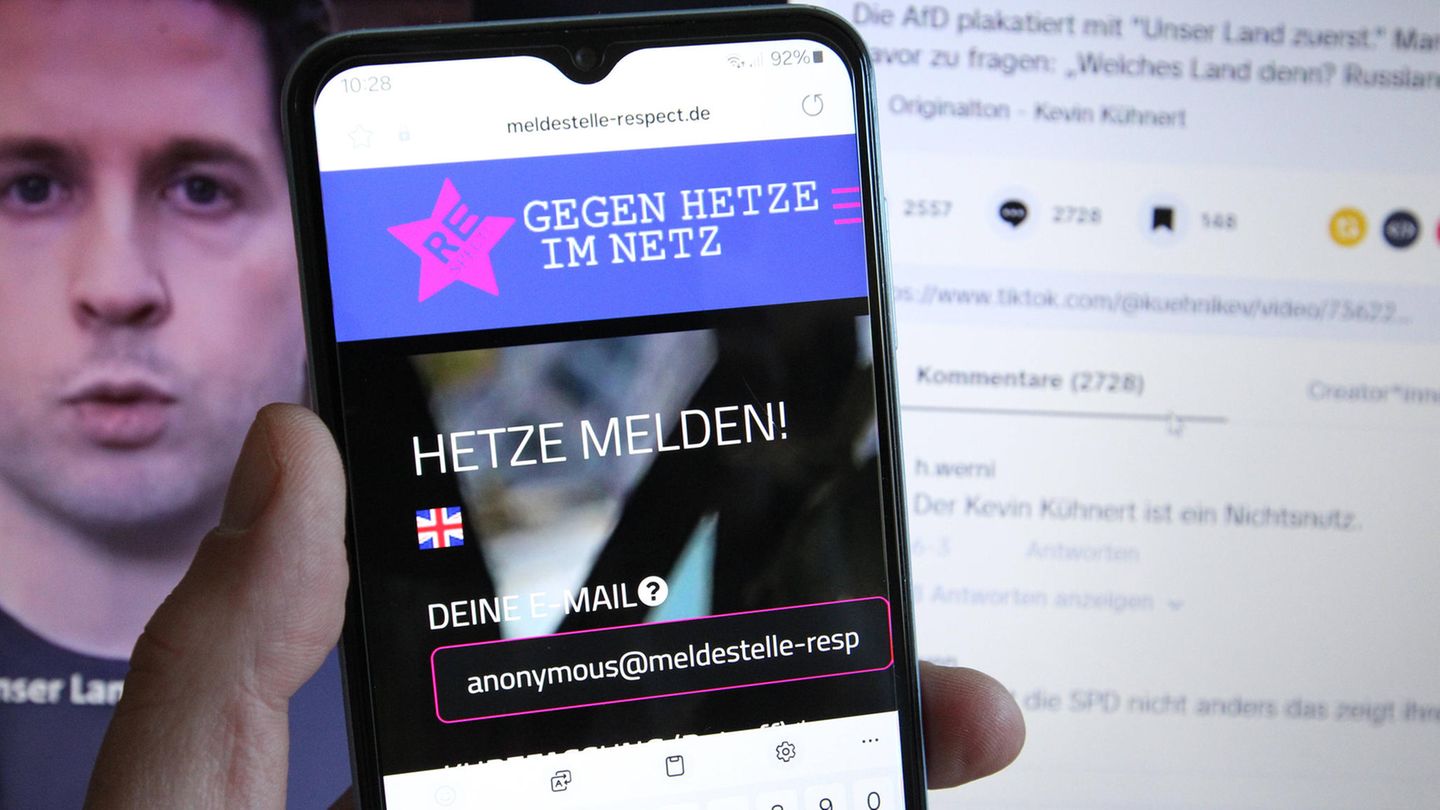

Anfang Oktober hat die Bundesnetzagentur den ersten deutschen Trusted Flagger für Online-Plattformen benannt. Bei dem „vertrauenswürdigen Hinweisgeber“, so die Übersetzung, handelt es sich um die Meldestelle „Respect“ der Jugendstiftung Baden-Württemberg. Ziel solcher Meldestellen ist es, illegale Inhalte, Hassreden und Fake News auf Facebook, Instagram und Co. schneller anzuzeigen und zu entfernen.

Prompt hagelte es Kritik. In den sozialen Medien baute sich eine regelrechte Empörungswelle über die angebliche „Zensurbehörde“ auf. Rechte und konservative Publikationen witterten eine „digitale Stasi“.

Aber was hat es mit den Trusted Flaggern auf sich und wofür werden sie kritisiert? Stellen sie wirklich eine Bedrohung unserer freiheitlichen Demokratie dar, weil sie die Meinungsfreiheit einschränken und die Bürger zu unmündigen Untertanen degradieren, wie die teilweise schrille Kritik verlautbarte?

Warum werden Trusted Flagger jetzt ernannt?

Ganz einfach. Mit der Benennung von Trusted Flaggern folgt die Bundesnetzagentur europäischem Recht. 2022 beschloss die EU den Digital Services Act (DSA), der in allen Mitgliedsländern gilt. Im Februar dieses Jahres wurde er in deutsches Recht übernommen („Gesetz über digitale Dienste“). Der DSA soll besser vor rechtswidrigen Inhalten im Internet schützen und Plattformen wie Facebook, X, Tiktok oder Instagram drängen, stärker dagegen vorzugehen. Das gilt für Darstellungen sexuellen Missbrauchs an Kindern, für gefälschte Produkte und eben auch für rechtswidrige Inhalte wie Volksverhetzung, Beleidigung, Gewaltandrohung, Antisemitismus etc. Für die Umsetzung des Gesetzes in Deutschland ist die Bundesnetzagentur zuständig.PAID TikTok-Fußballer Ahmed Amin Belhadj 17Uhr

„Respect“ wurde von der Netzagentur ausgewählt, weil die Organisation seit 2017 Menschen eine Anlaufstelle und Expertise bietet. Neben „Respect“ gibt es noch zahlreiche weitere Organisationen, die ähnlich arbeiten.

Entscheidend ist: Plattformbetreiber wie Facebook oder X sind durch den DSA verpflichtet, durch Trusted Flagger gemeldete Inhalte zu überprüfen. Wenn sie diese nicht löschen, müssen sie begründen, warum die Inhalte online bleiben.

Wie arbeitet die Meldestelle „Respect“?

Laut Auskunft von Petra Densborn, Vorsitzende der Jugendstiftung Baden-Württemberg, arbeiten täglich vier bis fünf Personen an den Meldungen, die bei „Respect“ eingereicht werden. Dabei werde geprüft, ob es sich vielleicht um einen strafbaren Inhalt handeln könne. Sollte das der Fall sein, werde die Meldung an das Bundeskriminalamt (BKA) weitergeben, das ebenfalls nachprüft.

Kommen BKA und Staatsanwaltschaft zu der Auffassung, dass ein Anfangsverdacht vorliegt, wendet sich „Respect“ mit den Meldungen an den Plattformbetreiber. Der ist dann durch das neue Gesetz gezwungen, den Inhalt zu löschen oder zu begründen, warum der Beitrag online bleiben könne. Rund 85 Meldungen erreichen die Organisation täglich. „In keinem Fall entscheiden wir selber, was gelöscht wird“, sagte Densborn der „Süddeutschen Zeitung“. „Wir sind keine Sanktionsstelle.“ Demnach lässt „Respect“ knapp 40 Prozent der eingehenden Online-Inhalte von der Staatsanwaltschaft überprüfen.

Wie groß ist der staatliche Einfluss?

Trusted Flagger müssen unabhängig von den Online-Plattformen sein. Das gilt nicht für das Verhältnis zur Politik. „Respect“ ist zwar eine private Stiftungsorganisation und muss sich grundsätzlich selbst finanzieren (Mitgliedsbeiträge, Stiftungskapital, Drittmittel), wird aber staatlich gefördert. Laut Auskunft von Klaus Müller, Chef der übergeordneten Bundesnetzagentur, schießen die Länder Bayern und Baden-Württemberg und das Bundesfamilienministerium Geld zu.

Anzeichen für eine Einflussnahme der Politik, Inhalte unterhalb der Strafbarkeit zu verfolgen, gibt es dennoch keine. „Respect“ ist allein dem DSA verpflichtet. Hinterfragt wird allerdings, dass Müller in einer Doppelrolle agiert. Einerseits ist er Behördenchef, der an die Weisungen von Robert Habecks Bundeswirtschaftsministerium gebunden ist, andererseits ist er gleichzeitig nationaler Digitale-Dienste-Koordinator, der qua EU-Regel komplett unabhängig sein soll.

Verstärkt wurde die Kritik der Einflussnahme durch eine ungeschickte Pressemitteilung der Müller-Behörde. Darin hieß es: „Plattformen sind verpflichtet, auf Meldungen von Trusted Flaggern sofort zu reagieren. Illegale Inhalte, Hass und Fake News können sehr schnell und ohne bürokratische Hürde entfernt werden.“ Das erweckte den Eindruck, die Trusted Flagger könnten im Verbund mit der Bundesnetzagentur nach Belieben festlegen, was illegale Inhalte seien. Das ist nicht der Fall. Fake News und Hassreden sind nicht pauschal löschpflichtig.

Zur Kontrolle wird die Arbeit von „Respect“ und ähnlicher Organisation regelmäßig überprüft. Trusted Flagger sind verpflichtet, jährlich ausführliche Berichte über ihre Arbeit zu veröffentlichen.PAID Medienpsychologe 13.31h

Wie lauten die Vorwürfe genau?

Kritiker befürchten Zensur. Das entspricht dem allgemeinen rechten Topos, dass man seine Meinung nicht mehr frei äußern könne und politisch unliebsame Meinungen unterdrückt würden. Hierzu ein Fakt: Es geht um illegale Inhalte, die strafrechtlich relevant sind (und es schon immer waren). Laut BKA-Statistik erfüllen 80 Prozent der Inhalte, die von „Respect“ und ähnlichen Organisationen pro Jahr in Deutschland gemeldet werden, den Anfangsverdacht einer Straftat. Zudem sind Trusted Flagger kein neues Phänomen. Online-Plattformen haben auch vor Inkrafttreten des DSA mit Trusted Flaggern zusammengearbeitet, um illegale Posts zu begrenzen.

Wichtig: Jeder Nutzer, dessen Inhalt auf den Index geraten ist, kann sich dagegen wehren. Auch dafür gibt es Meldestellen und die Möglichkeit, die Löschung juristisch prüfen zu lassen. Eine sogenannte Schlichtungsstelle ist unter www.user-rights.org zu erreichen.

Ein weiterer Vorwurf: Trusted Flagger fördern das Denunziantentum in der Bevölkerung. Es gibt jedoch keinerlei Hinweise dafür, dass durch Meldestellen eine Kultur des Anschwärzens unterstützt wird. Bisherige Erfahrungen zeigen eher, dass Meldestellen selbst massiven Attacken ausgesetzt sind, um deren Arbeit zu behindern. So wurde das Portal der Amadeu-Antonio-Stiftung, bei dem man antifeministische Postings und Vorfälle anzeigen kann, zu Beginn mit Hass-Nachrichten geflutet. Dadurch wurde die Notwendigkeit solcher Meldestellen umso deutlicher.

Eine weitere Befürchtung der Kritiker lautet, dass sich die Online-Plattformen in vorauseilendem Gehorsam selbst beschränken und legale Inhalte löschen, um sich juristischen Ärger zu ersparen. So hat der Konzern Meta, zu dem Facebook gehört, seine „Gemeinschaftsstandards“, in denen erlaubte und unerlaubte Inhalte definiert sind, stellenweise schärfer gefasst als nach deutschem Recht nötig.

Der Vorwurf hat seine Berechtigung, es ist aber zweifelhaft, ob eine gewisse Selbstkontrolle zu einer ernsthaften Beschränkung der Meinungsfreiheit führt. Online-Plattformen haben eigene Richtlinien und entfernen dementsprechend Inhalte oft unabhängig von Gesetzen. Einfach, weil sie es können.

Ein Schwachpunkt im DSA ist der Begriff Hassrede, der schwammig definiert ist. Hassreden sind oft als Meinungsäußerungen zu werten, auch wenn sie beleidigend oder gar menschenverachtend sind. Problematisch ist es auch, dass Manager der Plattformen persönlich haften, wenn ihre Unternehmen den DSA verletzen, also beispielsweise deutlich zu wenig löschen. Das kann den gegenteiligen Effekt befördern: dass immer wieder Fälle vor deutschen Gerichten landen, weil Facebook und andere Plattformen legale Meinungsbeiträge gelöscht haben.

Quellen: „Tagesschau„, „Tagesschau„, „Zeit„, „Cicero„, „Süddeutsche Zeitung„, „Handelsblatt„, „Welt„, Schlichtungsstelle der Bundesnetzagentur, AFP